百度站长平台robots工具升级公告

亲爱的网站管理员,

很高兴的告诉大家,百度站长平台robots工具全新升级,升级后能够实时查看网站在百度中已生效的的robots文件,并支持对robots进行语法及逻辑校验,有助于站长更清晰的管理网站的robots文件,避免错误的封禁搜索引擎。

功能亮点:

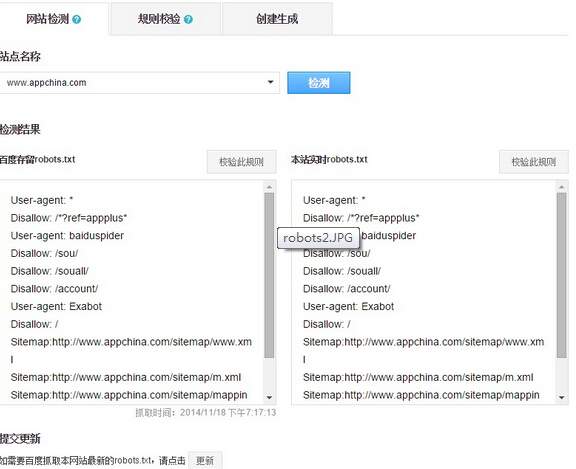

1、实时查看网站在百度中已生效的robots文件内容并可通知百度更新:

升级后的robots能够查看网站已生效的robots文件,同时会展现网站最新的robots文件。若当前生效的并非最新的robots内容,可在工具中点击“更新”提醒百度。百度竞价账户托管,制作网站推荐阅读>>> 怎样写robots文件_robots文件写法技巧_robot.txt的例子,

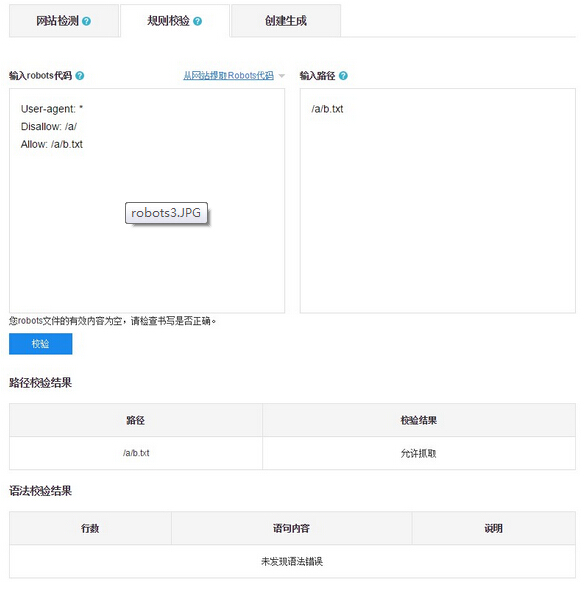

2、支持对robots文件进行语法及逻辑校验:

在robots工具—规则校验—填写Robots规则—填写被实验的路径中,点击“校验”,会展现该路径是否能被成功被封禁、或者Robots规则是否有语法错误。Robots填写还支持从已验证网站直接导入robots内容。

robots工具地址:http://zhanzhang.baidu.com/robots/index

哪些情况下需要使用robots工具?

1、我的网站下有某个目录涉及到了隐私数据,不想被搜索引擎收录。

此时您可以使用robots工具—创建生成页面中,根据robots规则创建正确的robots文件,并将robots文件上传到网站顶级目录中。陕西制作网站的公司,建企业网站推荐阅读>>> robots.txt文件详细解说,禁止搜索引擎收录的方法,

2、我用robots封禁了网站的某目录,但依然被抓取,怎样查设置的robots文件是不是已生效?如果还未生效,怎样提醒百度更新?

查看网站已生效的robots文件:您可以在robots工具—robots检测—下拉列表选取站点域名,点击“检测”,就可查看网站已生效的robots文件,并同时会展现网站最新的robots文件。

提醒百度更新网站的robots文件:若已生效的robots文件不是最新的,那可在“robots检测”页面的下方“提交更新”处点击更新进行提醒。

3、我的网站设置robots文件,怎样判断设置的是否正确?

您可在robots工具—规则校验中, 对robots代码的语法及逻辑进行校验,并可校验路径是否被封禁。

(1)校验语法或逻辑错误:您可在robots工具—规则校验中,输入robots代码,点击“校验,会展现您所填写的Robots规则是否有语法错误。Robots填写还支持从已验证网站直接导入robots内容。

(2)校验路径是否被封禁:您可在robots工具—规则校验中,分别输入robots代码、需要校验的路径,点击“校验”,会额外展现该路径是否成功被封禁。西安网站建设哪里好,网站设计制作推荐阅读>>> robots.txt文件的重要作用意义,

作者:百度站长平台 发布时间:2014年11月27日

相关文章:

-

User-agent: * Disallow: / Allow: /complain/ Allow: /media_partners/ Allow: /about/ Allow: /user_agreement/ User-agent: ByteSpider Allow: / User-agent: ToutiaoSpider Allow: / 以上是今日头条的robots.txt,禁止所有搜索引擎收录,同时又...

-

有同学问百度站长学院一个关于robots的问题:我们有个站点的目录结构使用的是中文,这样式儿的:www.a.com/冒险岛/123.html,那在制作robots文件和sitemap文件的时候,可以直接使用中文吗?百度能...

-

robots文件是搜索生态中很重要的一个环节,同时也是一个很细节的环节。很多站长同学在网站运营过程中,很容易忽视robots文件的存在,进行错误覆盖或者全部封禁robots,造成不必要损失! 那...

-

目前百度图片搜索也使用了与百度网页搜索相同的spider,如果想禁止Baiduspider抓取网站上所有图片、禁止或允许Baiduspider抓取网站上的某种特定格式的图片文件可以通过设置robots实现:西安广告...

-

对于百度搜索引擎来说,蜘蛛黑洞特指网站通过极低的成本制造出大量参数过多、内容类同但url不同的动态URL ,就像一个无限循环的黑洞,将spider困住。spider浪费了大量资源抓取的却是无效网...

-

robots是站点与spider沟通的重要渠道,站点通过robots文件声明该网站中不想被搜索引擎收录的部分或者指定搜索引擎只收录特定的部分。请注意,仅当您的网站包含不希望被搜索引擎收录的内容...

-

资料一 1.robots.txt文件是什么 robots.txt是一个纯文本文件,是搜索引擎中访问网站的时候要查看的第一个文件。robots.txt文件告诉蜘蛛程序在服务器上什么文件是可以被查看的。每个站点最好建立...

-

robots.txt文件包含一条或更多的记录,这些记录通过空行分开(以CR,CR/NL, or NL作为结束符),每一条记录的格式如下所示: field:optional spacevalueoptionalspace 在该文件中可以使用#进行注解,具体使...

-

搜索引擎通过一种程序robot(又称spider),自动访问互联网上的网页并获取网页信 息。您可以在您的网站中创建一个纯文本文件robots.txt,在这个文件中声明该网站中不想被robot 访问的部分,这...

-

Robots.txt对于任何一个从事SEO研究工作的人都是至关重要的,因为透过 Robots.txt 我们可以直接与搜索引擎蜘蛛进行对话,告诉他们哪些可以抓取,哪些不可以抓取。 一、为什么设置Robots.txt? 在...

客服

客服